IT-Trends 2024: Die 15 wichtigsten Technologien der Zukunft

Aktualisiert: 19.12.2023

Seiteninhalt

- 1 #1 IT-Trends der Zukunft – Künstliche Intelligenz: Der Treiber der IT-Evolution

- 2 #2 Internet of Things (IoT): Das Netzwerk der smarten Dinge

- 3 #3 Quantencomputing: Das nächste Kapitel der IT-Revolution

- 4 #4 IT-Trends 2024: Edge Computing – Der Weg zur Dezentralisierung der Datenverarbeitung

- 5 #5 5G-Technologie: Der Turbo im Motor der digitalen Transformation

- 6 #6 Autonomes Fahren: Die Zukunft fährt in selbstlernenden Fahrzeugen

- 7 #7 Blockchain: Der Baustein für Vertrauen und Transparenz

- 8 #8 IT-Trends 2024: Nachhaltige IT – Das grüne Gewissen in der digitalen Landschaft

- 9 #9 Metaverse: Die nächste Dimension der digitalen Interaktion

- 10 #10 Cybersecurity: Der unverzichtbare Wächter in der digitalen Ära

- 11 #11 Virtual und Augmented Reality: Die Verschmelzung von Realität und Digitalität

- 12 #12 IT-Trends der Zukunft: Human Augmentation – Die Erweiterung menschlicher Fähigkeiten durch IT

- 13 #13 Personalisierte und prädiktive Medizin: Maßgeschneiderte Gesundheitslösungen dank IT

- 14 #14 Software 2.0: Der Aufstieg selbstschreibender Software

- 15 #15 Web3: Das dezentrale Internet von morgen

- 16 Fazit: IT-Trends 2024

#1 IT-Trends der Zukunft – Künstliche Intelligenz: Der Treiber der IT-Evolution

Künstliche Intelligenz (KI) stellt DEN IT-Trend der Zukunft dar, dessen Potenzial gerade erst am Horizont erkennbar wird. Die Technologie, die sich durch maschinelles Lernen und fortschrittliche Datenanalyse auszeichnet, revolutioniert bereits zahlreiche Branchen. Von der Automatisierung komplexer Arbeitsabläufe bis hin zur personalisierten Kundeninteraktion – KI wickelt Prozesse effizienter, genauer und adaptiver ab. Ihre Fähigkeit, intelligente Schlussfolgerungen aus der Verarbeitung großer Datenmengen zu ziehen, birgt neue Möglichkeiten bei beruflichen Herausforderungen und Entscheidungen. In Zukunft könnte KI in der Lage sein, nicht nur routinemäßige Aufgaben zu übernehmen, sondern auch kreative, strategische Prozesse zu unterstützen, was ihre Rolle als unverzichtbares Werkzeug in der IT-Landschaft weiter festigt. Mit fortschreitender Entwicklung und Integration in diverse Systeme wird künstliche Intelligenz zweifelsohne einen maßgeblichen Einfluss auf die Art und Weise haben, wie wir ab 2024 arbeiten, lernen und kommunizieren.

#2 Internet of Things (IoT): Das Netzwerk der smarten Dinge

Das Internet of Things (IoT), zu Deutsch: Internet der Dinge, verbindet Milliarden von Geräten mit dem Internet. Fahrzeuge, Kühlschränke, Industriemaschinen sowie ganze Gebäude können mithilfe von Sensoren nicht nur gesammelte Daten austauschen, sondern auch lernen, selbstständig zu agieren. In Smart Homes beispielsweise passen sich die Heizsysteme und die Beleuchtung an die Gewohnheiten der Bewohner an, um Energie zu sparen. In Städten führt IoT zu intelligenteren Transportsystemen, die die Zahl der Unfälle verringern und die Luftqualität verbessern. Das Internet der Dinge ist ein entscheidender Baustein für Smart Cities, in denen Energieverwaltung, Verkehrsfluss und Notfalldienste durch ein Netzwerk von Sensoren miteinander verbunden sind. Es erleichtert besonders die Stadtplanung in bevölkerungsdichten Großstädten und trägt maßgeblich zum Umweltschutz der Zukunft bei.

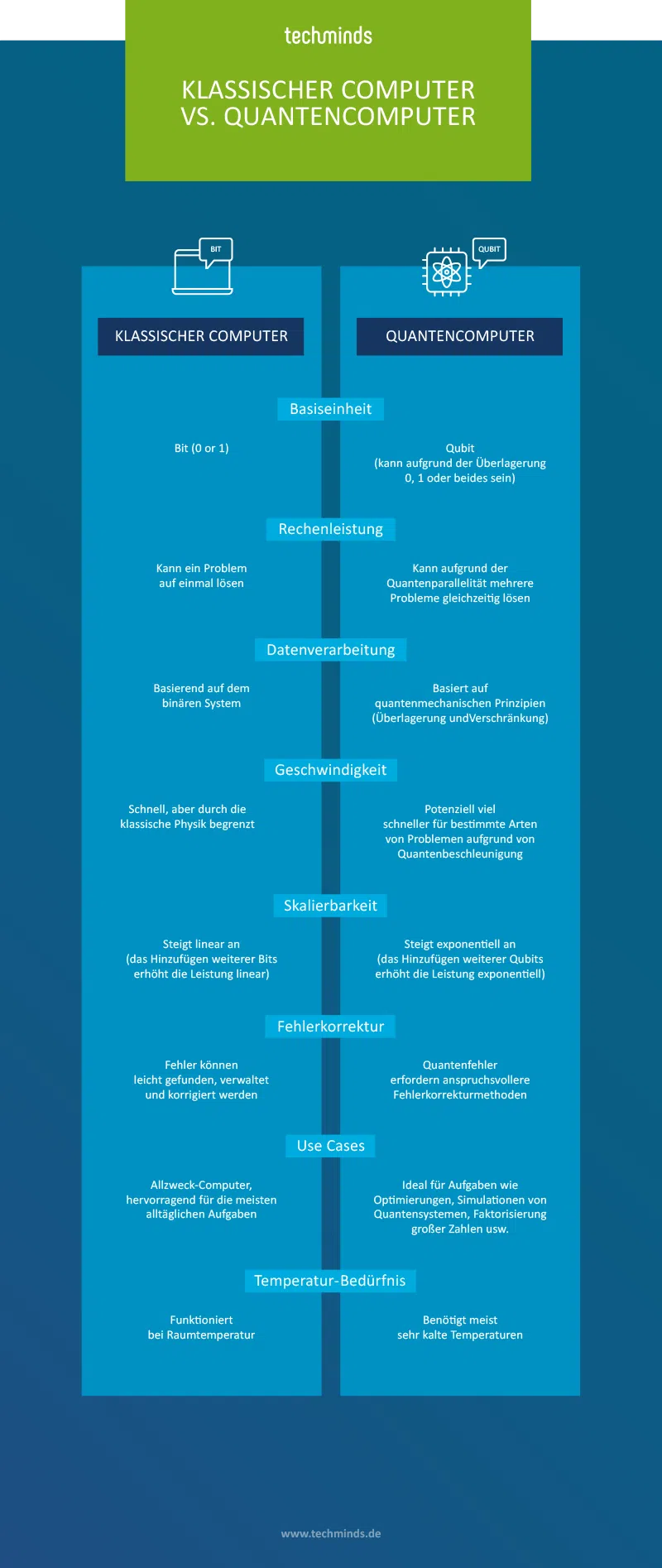

#3 Quantencomputing: Das nächste Kapitel der IT-Revolution

Quantencomputing gilt als einer der bahnbrechendsten IT-Trends der Zukunft, mit dem Potenzial, die Grenzen herkömmlicher Computertechnologie grundlegend zu verschieben. Im Gegensatz zu herkömmlichen Computern arbeiten Quantencomputer nicht mit Bits, sondern nutzen die Gesetze der Quantenmechanik. Diese neue Art des Rechnens führt extrem komplexe Berechnungen in Bruchteilen der Zeit durch, die heutige Supercomputer benötigen würden. In den kommenden Jahren könnte Quantencomputing den IT-Sektor komplett umgestalten. Forscher hoffen auf Durchbrüche bei der Entwicklung von Medikamenten, da Quantencomputer komplexe molekulare Strukturen simulieren. Ein anderes Projekt konzentriert sich darauf, mit Quantencomputing die Verkehrsführung so zu optimieren, dass Staus in Zukunft gar nicht erst entstehen.

Die „Quantum Supremacy“, also die Quantenüberlegenheit, steht bevor – ein Zeitalter, in dem die IT-Landschaft mit Quantencomputern revolutioniert wird, die selbst die Leistung der besten Supercomputer in den Schatten stellen. Ihre Fähigkeit, Probleme anzugehen, die für heutige Computer unlösbar sind, macht Quantencomputing zu einem der vielversprechendsten und aufregendsten IT-Trends in der Zukunft.

#4 IT-Trends 2024: Edge Computing – Der Weg zur Dezentralisierung der Datenverarbeitung

Edge Computing bringt die Rechenleistung näher an den Ort, an dem die Daten entstehen – an den Rand des Netzwerks, wo Entscheidungen in Echtzeit fallen müssen. Reaktionszeiten werden verkürzt, während sich die Betriebszuverlässigkeit erhöht. Denken Sie an autonome Fahrzeuge, die in Millisekunden eine Situation analysieren und entsprechend darauf reagieren können, oder an Produktionslinien, die Ausfälle antizipieren, bevor sie auftreten. Edge Computing sendet Daten nicht – wie übliche Computer – über weite Strecken, wodurch eine blitzschnelle Verarbeitung sichergestellt wird. Informationen werden stattdessen lokal verarbeitet, was eine sofortige Datenanalyse möglich macht – eine Voraussetzung für kritische Anwendungen, die nicht auf die Bearbeitung in weit entfernten Datenzentren warten können. Dieser Trend ist die Grundlage für den Erfolg des Internets der Dinge, bei dem Geräte und Sensoren ununterbrochen Daten generieren.

#5 5G-Technologie: Der Turbo im Motor der digitalen Transformation

5G ist zwar schon länger ein IT-Trend, 2024 dennoch weiterhin ausbaufähig. Das schnelle Netz ist nicht nur ein nächster Schritt in der Entwicklung der mobilen Konnektivität, sondern auch ein gigantischer Sprung, der das Potenzial hat, die Gesellschaft und die Wirtschaft tiefgreifend zu verändern. Die Technologie steht für Geschwindigkeit – ein Beispiel ist das bereits erwähnte Internet der Dinge, das 5G erheblich beschleunigt und so Automatisierung und Interaktivität auf ein neues Level hebt. Die beeindruckende Geschwindigkeit führt zu einer geringen Latenz, also zu einer sehr kurzen Zeitspanne zwischen dem Senden einer Information und der entsprechenden Antwort. Entscheidend sind geringe Latenzen beispielsweise beim autonomen Fahren, aber auch bei vielen anderen Anwendungen wie etwa der Telechirurgie, bei der Ärzte aus der Ferne operieren, indem sie Roboter in Echtzeit steuern. 5G dient auch als Katalysator für künstliche Intelligenz und maschinelles Lernen, indem der Mobilfunkstandard die benötigten Datenmengen schneller als jemals zuvor bereitstellt.

#6 Autonomes Fahren: Die Zukunft fährt in selbstlernenden Fahrzeugen

Die Integration von KI, 5G-Konnektivität und Edge Computing sollen sie bald Wirklichkeit werden lassen: autonome Fahrzeuge, die ihre Umgebung besser verstehen als ein Mensch es je könnte. Autos, die durch komplexe Verkehrsszenarien navigieren, mit einer Präzision und Sicherheit, die den Fähigkeiten menschlicher Fahrer weit überlegen sind. Das erhoffte Resultat? Der Verkehr fließt reibungsloser, schneller, sicherer, es gibt weniger Staus, keine Unfälle (Ziel: „Vision Zero“, also null Verkehrstote) und weniger Umweltbelastung. Doch nicht nur das: Die Zeit, die wir bisher hinter dem Steuer verbringen, werden wir für produktivere oder angenehmere Aktivitäten nutzen können. Und jeder – unabhängig von Alter, Gesundheitszustand oder Fähigkeiten – wird in Zukunft die Chance haben, mobil zu bleiben.

Autonomes Fahren wird in 5 Stufen unterteilt: Assistiert, teilautomatisiert, hochautomatisiert, vollautomatisiert, autonom. Bisher gibt es in Deutschland nur ein Fahrzeug, dass die Technik bis Level 3 enthält, ein Mercedes S-Klasse mit Drive Pilot. Dieser kann deutlich mehr als einfache Spurhalte- und Autobahnassistenten. Der Fahrer könnte zum Beispiel Filme schauen oder ein Buch zur Hand nehmen. Die deutschen Behörden erteilten für dieses Fahrzeug die Erlaubnis, auf Autobahnen und nur bis Tempo 60 km/h autonom zu fahren. Gerät der Verkehr ins Stocken oder steht der Fahrer im Stau, kann er aufs autonome Fahren umschalten und sich entspannt zurücklehnen.

Bis Fahrzeuge mit Level 4 oder 5 auf die Straßen kommen – bei denen kein Mensch mehr am Steuer sitzen muss – wird es laut Autoverband VDA noch mindestens bis 2030 dauern.

#7 Blockchain: Der Baustein für Vertrauen und Transparenz

Blockchain-Technologie ist längst nicht mehr nur das Rückgrat von Kryptowährungen. Sie ist ein disruptiver IT-Trend, der den Grundstein für sämtliche digitale Transaktionen legt. Durch ihre unveränderliche dezentralisierte Datenbank oder ein ‚Ledger‘, bietet sie ein Maß an Sicherheit und Transparenz, das in der IT bisher unerreicht war. Da jede Transaktion in einem Block festgehalten und über ein Netzwerk von Computern validiert wird, ist es fast unmöglich, Informationen nachträglich zu manipulieren. In einer Zeit, in der Datenschutz und -sicherheit zu den wichtigsten Themen gehören, wird die Blockchain zur Plattform für Systeme, die auf diese hohen Sicherheitsstandards angewiesen sind – von Finanztransaktionen bis hin zum Schutz geistigen Eigentums.

Darüber hinaus automatisiert Blockchain Prozesse durch sogenannte Smart Contracts. Die selbstausführenden Verträge mit den im Code festgelegten Bedingungen können Transaktionen aller Art schneller, sicherer, kostengünstiger und ohne Menschen durchgeführt werden. In Zukunft könnte die Blockchain-Technologie eine Schlüsselrolle bei der Gestaltung digitaler Identitäten, bei der Gewährleistung von Urheberrechten und im Gesundheitswesen spielen, indem sie zum Beispiel Patientendaten sicher und effizient verwaltet. Auch bei globalen Lieferketten garantiert die Blockchain Rückverfolgbarkeit und Transparenz. Diese Vielseitigkeit und Sicherheit machen sie zu einem der vielversprechendsten IT-Trends für die Zukunft.

#8 IT-Trends 2024: Nachhaltige IT – Das grüne Gewissen in der digitalen Landschaft

Nachhaltigkeit ist ein globaler Imperativ für den IT-Sektor. Es geht darum, eine Infrastruktur zu schaffen, die leistungsstark, effizient und zugleich umweltfreundlich ist. Angesichts der Bedrohungen durch den Klimawandel wächst die Notwendigkeit, den ökologischen Fußabdruck zu minimieren. Nachhaltigkeit in der IT bedeutet unter anderem, die Lebensdauer von Geräten zu verlängern, die Energieeffizienz zu steigern und die Wiederverwertung von technischem Abfall zu fördern. Grüne Rechenzentren etwa, die diese Maßnahmen umsetzen und erneuerbare Energien nutzen, verbessern erheblich ihre CO2-Bilanz. Nachhaltigkeit umfasst aber auch soziale Aspekte: Technologie soll inklusiv sein, den digitalen Graben überbrücken und jedem Zugang zu digitalen Ressourcen ermöglichen. Faire Arbeitsbedingungen in der IT-Branche und der größtmögliche Datenschutz gehören ebenso dazu. Firmen, die sich Nachhaltigkeit im Unternehmen, Umweltschutz und soziale Verantwortung auf die Fahne schreiben, werden als attraktive Geschäftspartner gesehen. Sie punkten sowohl bei der Personalbindung als auch bei der Personalsuche – ein wesentlicher Erfolgsfaktor in Zeiten von IT-Fachkräftemangel.

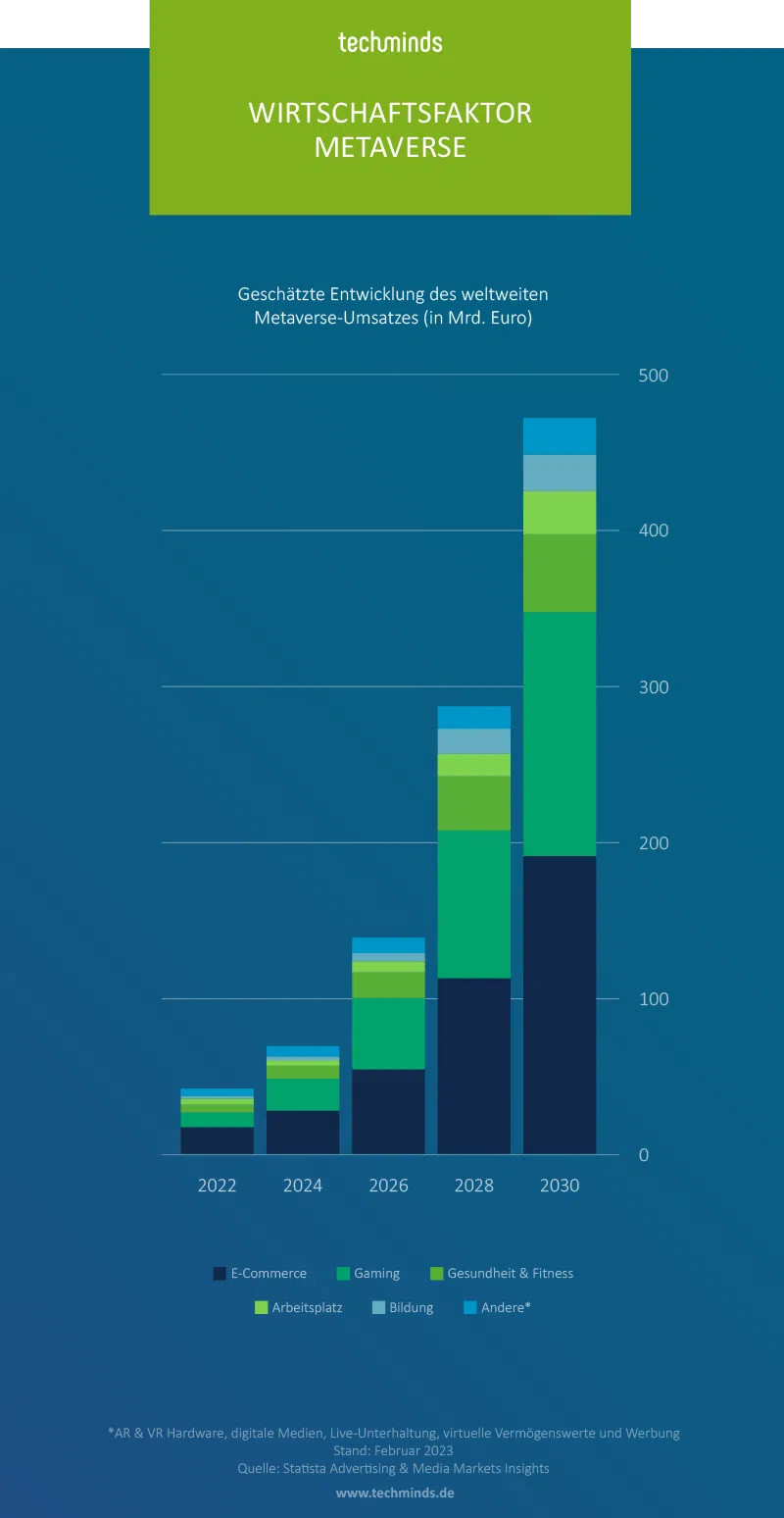

#9 Metaverse: Die nächste Dimension der digitalen Interaktion

Das Metaverse ist die Vision einer interaktiven digitalen 3D-Umgebung, in der Menschen leben, arbeiten und spielen. Die virtuelle und die echte Welt verschmelzen dabei zu einer einzigen, nahtlosen Erfahrung. Das Netzwerk soll mehr als nur eine Plattform für Gaming und soziale Medien sein – nämlich auch ein Ort, an dem in Zukunft Geschäfte abgeschlossen, Konzerte besucht und Immobilien gekauft werden – alles in Echtzeit und mit globaler Reichweite. Mithilfe von Virtual und Augmented Reality werden immersive Erlebnisse geschaffen, die alle Sinne ansprechen. Die Nutzer navigieren mit personalisierten Avataren durch ein Universum, das so vielfältig und grenzenlos ist wie die Vorstellungskraft ihrer Schöpfer. Das Metaverse soll auch als Bühne für Innovationen in den Bereichen Arbeit, Bildung und in der Kreativindustrie dienen und einen Marktplatz für Waren und Dienstleistungen schaffen.

#10 Cybersecurity: Der unverzichtbare Wächter in der digitalen Ära

Cybersecurity ist der unverzichtbare Schild gegen die wachsenden Bedrohungen im Cyberspace. Die Zahl digitaler Informationen im Netz wächst ständig, damit auch das Risiko von Datenlecks oder Cyberangriffen. Effektive Sicherheitsstrategien sind also zwingend erforderlich. Cybersecurity entwickelt sich kontinuierlich weiter, um gegen immer ausgefeiltere Angriffe gewappnet zu sein. IT-Trends wie KI und maschinelles Lernen werden in die Programme integriert, um Anomalien in Echtzeit zu erkennen und präventive Abwehrmaßnahmen zu ergreifen. Die Cybersecurity von morgen ist sowohl intelligent als auch vorausschauend. Sie schützt einzelne Datenpunkte, ganze Netzwerke oder Ökosysteme. Durch Verschlüsselungstechniken, biometrische Authentifizierung und umfassende Bedrohungsanalysen wird ein Bollwerk um unsere digitalen Lebensräume errichtet. Neben der Verteidigung gegen Angriffe ist es auch entscheidend, eine vertrauensvolle Atmosphäre für Nutzer und Unternehmen zu schaffen. In einer Zeit, in der Daten als das neue Gold gelten, ist Cybersecurity der Garant dafür, dass dieses Gold sicher verwahrt bleibt.

#11 Virtual und Augmented Reality: Die Verschmelzung von Realität und Digitalität

Virtual und Augmented Reality (VR/AR) verwischen die Grenzen zwischen realer und digitaler Welt. Sie schaffen immersive Erlebnisse, die Bildung, Unterhaltung und Berufsleben grundlegend verändern. Stellen Sie sich vor, Sie könnten durch VR geschichtsträchtige Ereignisse hautnah erleben oder mithilfe von AR neue Möbel virtuell in Ihrer Wohnung platzieren, bevor Sie eine Kaufentscheidung treffen. Auszubildende und Studierende lernen dank VR/AR praxisnah ohne räumliche oder zeitliche Grenzen. Angehende Ärzte können Operationen realitätsnah üben, Polizisten werden mithilfe von VR-Trainingsprogrammen auf hochriskante Einsätze vorbereitet. Komplexe Maschinen in der Industrie lassen sich mit AR-Unterstützung warten, was sie sicherer und weniger fehleranfällig macht. Die neuen Realitäten werden natürlich auch zum Vergnügen eingesetzt: In der Unterhaltungsbranche entführt Virtual Reality die Nutzer in hochrealistische interaktive Welten.

#12 IT-Trends der Zukunft: Human Augmentation – Die Erweiterung menschlicher Fähigkeiten durch IT

Human Augmentation, auch Human Enhancement genannt, erweitert unsere natürlichen Fähigkeiten durch Medizintechnik, etwa mithilfe von Exoskeletten, Prothesen und Chips im Körper. Medizinische Fortschritte wie bionische Gliedmaßen und implantierbare Geräte helfen Menschen mit Behinderung dabei, über ihre Grenzen hinauszuwachsen, verlorene Funktionen wiederzuerlangen oder bestehende Fähigkeiten zu verbessern. Von Prothesen, die natürliche Bewegungen nachahmen, bis hin zu Implantaten, die Seh- oder Hörfähigkeiten wiederherstellen oder verbessern – Human Augmentation erspart viel Leid. Auch im Militär und in der Arbeitswelt findet die Technologie Anwendung. Exoskelette, die die physische Leistungsfähigkeit steigern, können Soldaten oder Arbeitern in physisch anspruchsvollen Berufen unterstützen, sowohl effizienter als auch sicherer zu arbeiten.

Human Augmentation hat sogar das Potenzial, die menschliche Leistungsfähigkeit im Allgemeinen zu steigern. Es geht dabei nicht nur um physische Erweiterungen, sondern auch um kognitive Fähigkeiten. Neurotechnologische Innovationen, die auf Gehirn-Computer-Schnittstellen basieren, könnten menschliches Denken direkt mit Computern verbinden – unsere Lernfähigkeit, unsere Gedächtnisleistung und unsere berufliche Leistung werden dadurch auf ein völlig neues Level gehoben.

Trotz dieser vielversprechenden Anwendungen wirft Human Augmentation allerdings ethische, rechtliche und soziale Fragen auf. Die Themen Datenschutz, Zugänglichkeit und die potenzielle Schaffung einer „übermenschlichen“ Elite sind nur einige der Herausforderungen, die mit der Weiterentwicklung dieses IT-Trends 2024 und darüber hinaus einhergehen.

#13 Personalisierte und prädiktive Medizin: Maßgeschneiderte Gesundheitslösungen dank IT

Die personalisierte und prädiktive Medizin stellt einen Paradigmenwechsel in der Gesundheitsversorgung dar. In dieser neuen Ära werden Behandlungen und Präventionsstrategien individuell auf den Patienten zugeschnitten. Die prädiktive Medizin nutzt Big-Data-Analysen und Genomik, um Muster in Gesundheitsdaten zu identifizieren, die Hinweise auf zukünftige Erkrankungen geben. Krankheiten werden nicht nur behandelt, sondern auch vermieden, indem Risiken frühzeitig erkannt und präventive Maßnahmen eingeleitet werden. Patienten haben künftig weniger mit Nebenwirkungen zu kämpfen, da Medikamente und Therapien optimal an ihre individuellen Bedürfnisse angepasst oder bestenfalls persönlich gar nicht benötigt werden. Eine Win-Win-Situation: Krankenkassen sparen sich Millionen, während sich die Lebensqualität jedes Einzelnen verbessert.

#14 Software 2.0: Der Aufstieg selbstschreibender Software

Software 2.0 steht für einen Wendepunkt in der Entwicklung von IT-Lösungen. Hier geht es um eine neue Generation von Software, die nicht von Programmierern, sondern von neuronalen Netzwerken und Machine-Learning-Algorithmen geschrieben wird. Menschen definieren die Rahmenbedingungen und Ziele, während die KI die optimale Lösung findet und implementiert. Der Schlüssel zu Software 2.0 liegt in ihrer Fähigkeit, aus Daten zu lernen und Entscheidungen zu treffen. Statt dass Entwickler jeden Aspekt eines Programms explizit codieren, trainieren sie Modelle des maschinellen Lernens mit großen Datenmengen. Diese Modelle sind in der Lage, Muster zu erkennen sowie auf neue Daten zu reagieren, was ihnen eine beispiellose Flexibilität und Anpassungsfähigkeit verleiht.

Die Technologie hat weitreichende Implikationen für zahlreiche Bereiche. In der Softwareentwicklung ermöglicht sie eine schnellere, effizientere Entwicklung von Anwendungen, da die Maschinen zunehmend Aufgaben übernehmen, die zuvor manuelle Codierung erforderten. In Bereichen wie der Bild- und Spracherkennung, Vorhersageanalyse und automatisierten Entscheidungsfindung bietet Software 2.0 Möglichkeiten, die mit herkömmlichen Programmiermethoden unerreichbar waren. Software 2.0 kann sich an Veränderungen anpassen, ohne dass ein Entwickler eingreifen muss. Diese adaptiven Systeme sind besonders in dynamischen Umgebungen von unschätzbarem Wert, beispielsweise in der Automatisierung und in der personalisierten Medizin. Kurz gesagt, Software 2.0 ist eine aufregende Entwicklung, bei der Programme schlauer werden, indem sie aus Daten lernen, anstatt nur Befehlen zu folgen.

#15 Web3: Das dezentrale Internet von morgen

Das Web3 soll das heutige Internet ablösen, indem es Benutzerkontrolle und dezentrale Governance in den Vordergrund rückt. Es ist eine Bewegung weg von monopolisierten Plattformen hin zu einem Ökosystem aus vielen kleinen, von den Nutzern selbst verwalteten Einheiten, das auf der Blockchain basiert. Im Web3 sind Daten nicht mehr im Besitz zentraler Organisationen, sondern werden dezentral gespeichert. Zwischeninstanzen werden dadurch überflüssig, alle Parteien interagieren direkt miteinander, etwa über „Decentralized Applications“ (dApps), die Smart Contracts nutzen und unmittelbare Transaktionen ermöglichen. Für reale und digitale Vermögenswerte wie Immobilien, Kunst oder Musik können digitale Tokens auf der Blockchain erstellt und sicher gehandelt werden. Das Web3 ist ein Konzept für ein transparenteres, faireres Internet, in dem die Menschen nicht nur Konsumenten, sondern auch aktive Gestalter sind.

Fazit: IT-Trends 2024

Hier nochmal die Kurzzusammenfassung aller 15 IT-Trends 2024 auf einen Blick:

#1 Künstliche Intelligenz (KI): Sie durchdringt schon heute zahlreiche Branchen und löst mit selbstlernenden Systemen eigenständig komplexe Probleme.

#2 Internet of Things (IoT): Geräte und Maschinen werden mit dem Internet verbunden. Sie bilden die globale Infrastruktur für eine vernetzte Welt.

#3 Quantencomputing: Mit unvorstellbarer Rechenleistung könnten Quantencomputer die Art und Weise, wie wir Daten verarbeiten und verschlüsseln, grundlegend verändern.

#4 Edge Computing: Datenverarbeitung direkt an oder in der Nähe der Datenquelle minimiert Verzögerungen und erhöht die Effizienz. Besonders für das Internet der Dinge ist das ein Gamechanger.

#5 5G-Technologie: Die fünfte Generation des Mobilfunks wird nicht nur das Surfen beschleunigen. Sie ist auch das Rückgrat für autonome Fahrzeuge, Virtual Reality, vernetzte Maschinen und die Schlüsseltechnologie für zukünftige Innovationen.

#6 Autonome Fahrzeuge: Sie kombinieren KI, maschinelles Lernen und 5G, um uns sicherer von A nach B zu bringen.

#7 Blockchain-Technologie: Mehr als nur Bitcoin! Transparente, sichere Transaktionen finden zunehmend Anwendung in Lieferketten, beim Schutz von Urheberrechten und bei der Verifizierung der digitalen Identität.

#8 Nachhaltige IT: Der Druck auf Unternehmen, umweltfreundlich zu agieren, steigt. Energieeffiziente Hardware sowie grüne Rechenzentren sind Teil der Lösung.

#9 Metaverse: Es ist die Vision eines gemeinsamen Online-Universums, in dem Virtual Reality und echte Welt verschmelzen.

#10 Cybersecurity: Mit der Zunahme von Datenlecks steigt die Nachfrage nach innovativer IT-Sicherheit, die Schutz vor immer raffinierteren Angriffen bietet.

#11 Virtual und Augmented Reality (VR/AR): Diese Technologien revolutionieren die Art, wie wir lernen, arbeiten und uns unterhalten.

#12 Human Augmentation: Die Erweiterung körperlicher und kognitiver Fähigkeiten durch Technologie könnte die menschliche Erfahrung auf ein neues Level heben.

#13 Personalisierte und prädiktive Medizin: Moderne IT im Gesundheitswesen ermöglicht Behandlungen, die auf die genetische Ausstattung des Einzelnen abgestimmt sind.

#14 Software 2.0: Künstliche Intelligenz schreibt mithilfe von neuronalen Netzwerken und Machine Learning Programme.

#15 Web3: Die neue Generation des Internets verspricht mehr Transparenz, Nutzerfreundlichkeit und Unabhängigkeit.

Diese 15 IT-Trends sind nur die Spitze des Eisbergs einer Fülle neuer Technologien. Sie bieten aufregende Möglichkeiten, stellen uns aber auch vor ethische und praktische Herausforderungen, die es im Zuge der fortlaufenden Digitalisierung zu meistern gilt. Wie weit die digitale Transformation in Deutschland fortgeschritten ist, lesen Sie in unserem Beitrag „Digitalisierung in Deutschland“. Fest steht: Unser aller Leben wird von den IT-Trends der Zukunft beeinflusst werden – bereiten wir uns also darauf vor.

AUTOR DES BEITRAGS

Florenz Klasen, Wirtsch.-Ing. (Managing Partner, Senior HR Consultant)

Der gebürtige Hamburger, Florenz Klasen, studierte Wirtschaftsingenieurwesen in Hamburg und Birmingham. Zunächst arbeitete Herr Klasen im internationalen Tech-Konzern NXP und arbeitet nun seit über 7 Jahren im Executive / Expert Search. LinkedIn-Profil > | Interview mit Florenz Klasen >

Herr Klasen ist bei TechMinds Ihr primärer Ansprechpartner, ob zu Personalvermittlung von Führungskräften für IT & Tech, Fachkräftevermittlung oder Personalberatung für Digitale Transformation. TechMinds ist die Tech & IT Personalvermittlung und spezialisierter Tech & IT Headhunter mit Boutique-Charakter.